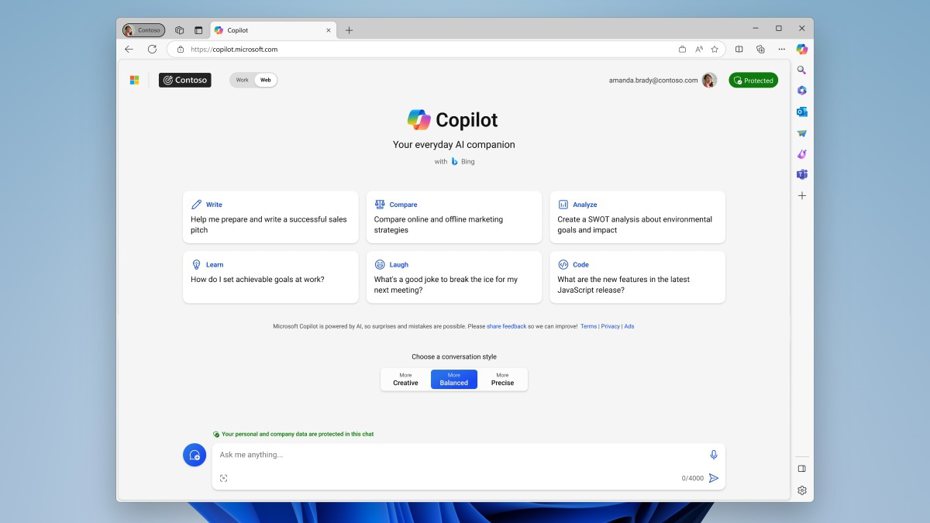

ChatGPT 、Copilot 或Gemini 等AI 聊天機器人 成為今日熱門討論焦點。然而這些生成式AI的正確性及隱私安全問題也屢屢躍上版面,近日有網友發現微軟 的Copilot遇到用戶輸入特定表情符號 時,就會突然產生錯誤、回覆一長串神秘文字。

據外媒《MSPowerUser》報導,近日有Reddit 網友發現微軟(Microsoft )推出的AI聊天機器人「Copilot」出現幻覺錯誤。當用戶輸入「🤬」代表生氣的表情符號時,Copilot不僅會回覆一長串不相關的文字訊息,甚至還是相當罕見的藏語(西藏語)。

當AI聊天機器人出現這種幻覺,通常是背後運用的AI模型將訓練的學習數據搞混,最後得出不相關資訊。也有網友表示微軟Copilot可能把表情符號視為2個藏語文字,從而導致幻覺發生。因此大部分的表情符號、Unicode萬國碼都有機會遇上這個現象。

而聯合新聞網《科技玩家》實際測試Copilot後也遇上相同問題,第一段由Bing翻譯成中文的意思是「我們是你的女朋友,我們是為不與許多歡樂的人打交道,為你不為你的饅頭而努力,為你不為你的饅頭而奮鬥,這次為你所不為的饅頭而努力」。

不僅如此,早前Google的Gemini因為生成歷史人物圖片太過政治正確而緊急暫停服務。先前有研究發現ChatGPT有時也會出現錯誤資訊,甚至一本正經的給出錯誤答案。亞馬遜Amazon Q甚至曾因幻覺洩露內部行銷折扣的計畫與機密資料。

Anybody else having the Tibetan script bug?

byu/AstronomerNo6423inbing